Xây dựng khung Quản trị và Bảo mật AI minh bạch năm 2026

Trong kỷ nguyên mà dữ liệu được ví như “nguồn điện thứ hai” của nền kinh tế số, niềm tin kỹ thuật số (digital trust) và tính minh bạch không còn là lựa chọn tùy nghi — chúng là điều kiện tiên quyết để doanh nghiệp tồn tại và phát triển trên bản đồ kinh tế toàn cầu. Bài viết này phân tích bức tranh toàn cảnh về quản trị AI, từ khung pháp lý bắt buộc, hiểm họa tiềm ẩn của “AI bóng tối”, đến các giải pháp kỹ thuật tiên tiến giúp doanh nghiệp kiến tạo một hệ sinh thái AI an toàn và bền vững.

Bài viết trích từ tham luận trình bày tại sự kiện

Hội thảo: AI-Powered Enterprise: From Data to Intelligent Operations

1. Kỷ Nguyên Quản Trị AI Bắt Buộc

Năm 2025 – 2026 đánh dấu một bước ngoặt lịch sử: quản trị AI chính thức chuyển từ các nguyên tắc tự nguyện sang thực thi pháp lý bắt buộc kèm theo chế tài nghiêm khắc. Không còn là câu chuyện của tương lai xa, áp lực tuân thủ đang diễn ra ngay hôm nay.

Tại Việt Nam, hai cột trụ pháp lý quan trọng đã định hình. Luật Bảo vệ Dữ liệu Cá nhân (PDPD) chính thức có hiệu lực diện rộng từ ngày 01/01/2026, nghiêm cấm mọi hành vi mua bán dữ liệu trái phép và áp mức phạt tối đa lên tới 5% doanh thu năm trước liền kề đối với các vi phạm chuyển dữ liệu xuyên biên giới. Song song đó, Luật Trí tuệ Nhân tạo — một trong những văn bản pháp lý tiên phong tại Đông Nam Á — đã được thông qua, xác lập mô hình quản lý dựa trên bốn cấp độ rủi ro: Không chấp nhận được, Cao, Trung bình và Thấp.

Hình 1: Mô hình 4 cấp độ rủi ro AI theo Luật Trí tuệ Nhân tạo Việt Nam và EU AI Act

Trên trường quốc tế, Đạo luật AI Châu Âu (EU AI Act) đã trở thành tiêu chuẩn vàng toàn cầu, với mức phạt lên tới 35 triệu EUR hoặc 7% tổng doanh thu toàn cầu của doanh nghiệp vi phạm. Sức lan tỏa của EU AI Act không dừng lại ở biên giới châu Âu — bất kỳ doanh nghiệp Việt Nam nào có khách hàng hoặc đối tác tại EU đều phải cân nhắc nghiêm túc sự tuân thủ này.

Câu hỏi đặt ra không phải là “Có nên tuân thủ không?” mà là “Hệ thống AI của chúng ta đang ở cấp độ rủi ro nào, và chúng ta đã sẵn sàng đến đâu?”

2. Mối Nguy Từ “Shadow AI” và Cái Giá Của Sự Thiếu Kiểm Soát

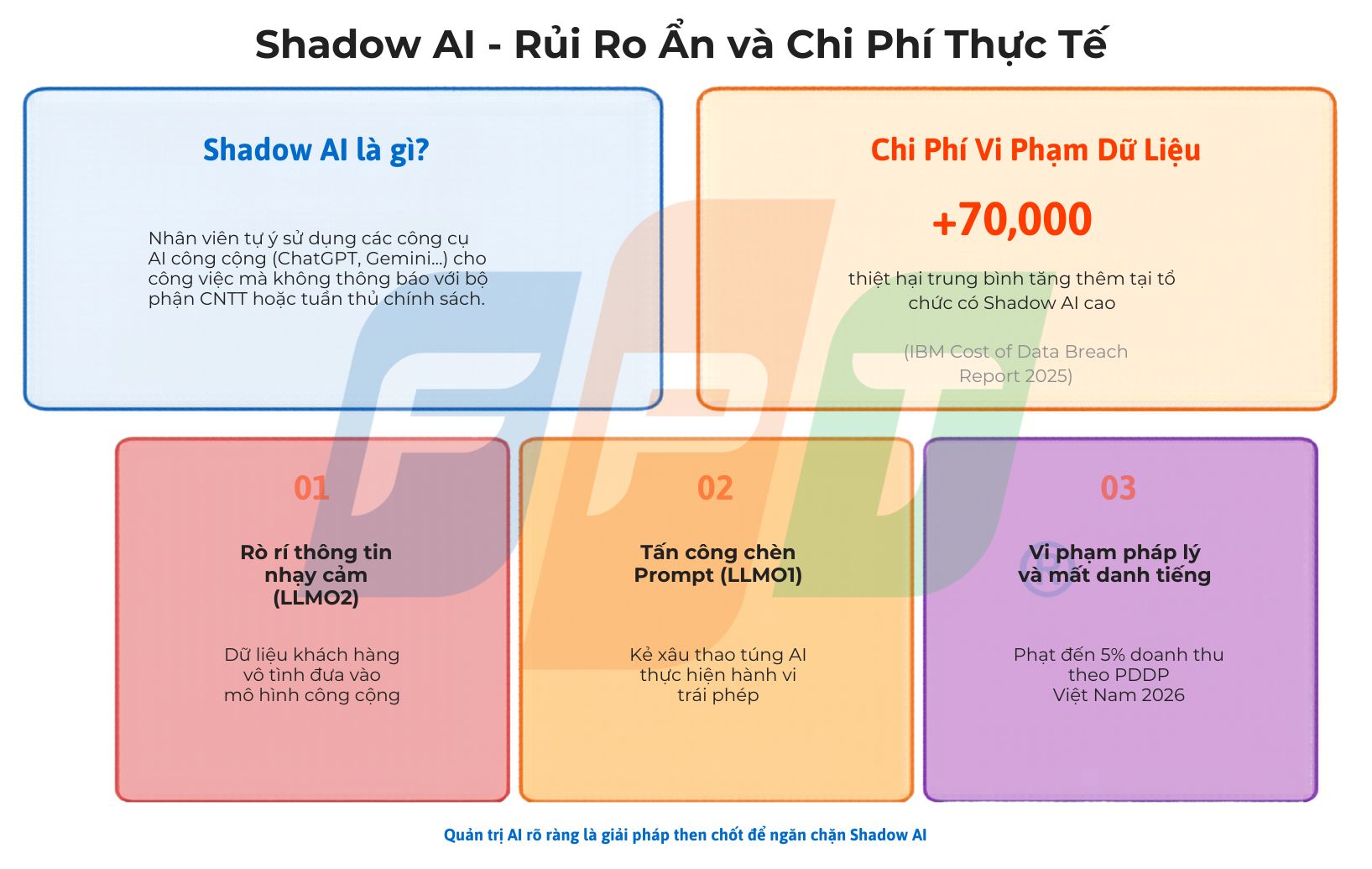

Sự phổ biến chóng mặt của các công cụ AI sinh tạo (Generative AI) miễn phí đang tạo ra một hiểm họa mới mà nhiều tổ chức chưa nhận ra: Shadow AI — hay “AI bóng tối”. Đây là hiện tượng nhân viên tự ý sử dụng các nền tảng AI công cộng như ChatGPT hay Gemini cho công việc hàng ngày mà hoàn toàn không thông báo với bộ phận CNTT hoặc tuân thủ bất kỳ chính sách bảo mật nào.

Hậu quả có thể rất nghiêm trọng. Theo Báo cáo Chi phí Vi phạm Dữ liệu của IBM năm 2025, các tổ chức có mức độ sử dụng AI ngầm cao phải đối mặt với mức thiệt hại vi phạm dữ liệu tăng thêm trung bình 670.000 USD so với các tổ chức có kiểm soát chặt chẽ. Con số này chưa tính đến tổn hại về uy tín và niềm tin từ đối tác, khách hàng.

Hình 2: Ba nhóm rủi ro chính từ Shadow AI và chi phí thực tế doanh nghiệp phải gánh chịu

Từ góc độ kỹ thuật, Shadow AI tạo ra ít nhất hai lỗ hổng bảo mật nghiêm trọng được xếp hạng trong danh sách OWASP Top 10 cho LLM. Thứ nhất là rò rỉ thông tin nhạy cảm (LLM02): nhân viên vô tình đưa dữ liệu khách hàng, bí mật kinh doanh hoặc thông tin tài chính vào các mô hình ngôn ngữ lớn công cộng — nơi những thông tin này có thể bị ghi nhớ và tiết lộ cho người dùng khác. Thứ hai là tấn công chèn Prompt (LLM01): kẻ tấn công tinh vi có thể cài cắm các chỉ thị độc hại để thao túng AI thực hiện hành vi trái phép hoặc đánh cắp dữ liệu nhạy cảm.

Thực tế từ ngành tài chính Việt Nam cho thấy mức độ nghiêm trọng của vấn đề. Một số ngân hàng đã phát hiện nhân viên bộ phận tín dụng sử dụng ChatGPT để soạn thảo báo cáo thẩm định khách hàng — kéo theo nguy cơ lộ lọt toàn bộ hồ sơ tài chính cá nhân, trực tiếp vi phạm PDPD và Thông tư về bảo mật thông tin trong lĩnh vực ngân hàng.

3. AI Gateway: “Vệ Sĩ Số” Thực Thi Chính Sách Tự Động

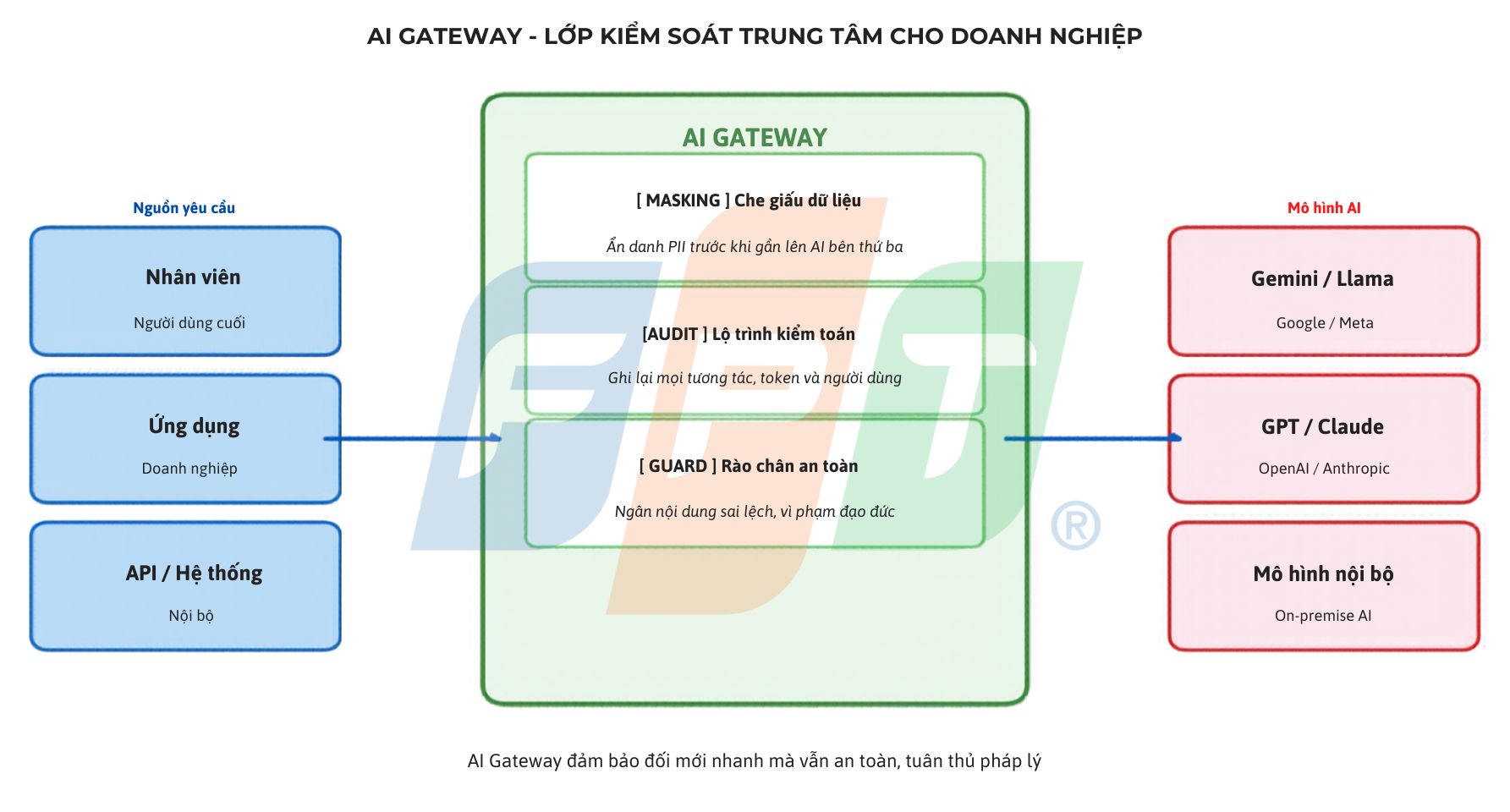

Làm thế nào để không làm chậm tốc độ đổi mới nhưng vẫn đảm bảo an toàn tuyệt đối? Câu trả lời không nằm ở những bản chính sách dày cộp mà ít ai đọc — mà nằm ở kiến trúc kỹ thuật. AI Gateway chính là lớp kiểm soát trung tâm (control plane) mà các tổ chức hàng đầu thế giới đang triển khai.

Hình 3: Kiến trúc AI Gateway — lớp bảo vệ trung gian giữa người dùng và mô hình AI

Nằm giữa ứng dụng doanh nghiệp và các mô hình AI bên ngoài, AI Gateway hoạt động như một “trạm kiểm soát thông minh” với ba chức năng cốt lõi. Tính năng che giấu dữ liệu động (Dynamic Masking) tự động phát hiện và ẩn danh hóa các thông tin định danh cá nhân (PII) hoặc dữ liệu tài chính ngay trước khi chúng được gửi tới bất kỳ nhà cung cấp AI bên thứ ba nào — đảm bảo dữ liệu nhạy cảm không bao giờ rời khỏi ranh giới kiểm soát của tổ chức dưới dạng thô. Lộ trình kiểm toán (Audit Trail) ghi lại đầy đủ mọi tương tác AI, bao gồm danh tính người dùng, nội dung yêu cầu, mức tiêu thụ token và thời gian phản hồi — tạo ra bằng chứng số không thể chối bỏ phục vụ cho mọi cuộc thanh tra pháp lý. Và cuối cùng, các rào chắn an toàn (Guardrails) áp dụng bộ lọc nội dung thông minh để ngăn AI đưa ra các câu trả lời sai lệch, thiên kiến hoặc vi phạm giá trị đạo đức của doanh nghiệp.

Citibank — một trong những ngân hàng lớn nhất thế giới — đã triển khai AI Gateway kết hợp với IBM Guardium để kiểm soát toàn bộ luồng dữ liệu tới các mô hình AI. Kết quả: giảm 94% các sự kiện truy cập dữ liệu trái phép trong vòng sáu tháng đầu triển khai, đồng thời giảm 40% thời gian chuẩn bị báo cáo tuân thủ hàng quý.

4. Công Nghệ Tăng Cường Quyền Riêng Tư (PETs): Khai Thác Dữ Liệu Mà Không Cần “Nhìn Thấy”

AI đòi hỏi lượng dữ liệu khổng lồ để học hỏi và vận hành. Nhưng luật pháp ngày càng siết chặt quyền truy cập vào dữ liệu cá nhân. Đây là mâu thuẫn cốt lõi mà nhiều doanh nghiệp chưa biết cách hóa giải. Bộ công nghệ Tăng cường Quyền riêng tư (Privacy-Enhancing Technologies — PETs) chính là chiếc cầu nối giải quyết mâu thuẫn này.

Học liên kết (Federated Learning) cho phép huấn luyện mô hình AI ngay tại nguồn chứa dữ liệu — trên thiết bị của khách hàng hoặc chi nhánh địa phương — mà không cần tập trung dữ liệu thô về máy chủ trung tâm. Google đã áp dụng kỹ thuật này để huấn luyện mô hình dự đoán bàn phím Gboard trên hàng tỷ thiết bị Android mà không bao giờ tiếp cận nội dung tin nhắn của người dùng.

Mã hóa đồng cấu (Homomorphic Encryption) đưa bảo mật lên một tầm cao mới: cho phép AI thực hiện các phép tính phức tạp trực tiếp trên dữ liệu đang bị mã hóa, tức là kết quả phân tích được tạo ra mà không cần giải mã dữ liệu gốc tại bất kỳ thời điểm nào. Đây là công nghệ đặc biệt phù hợp cho lĩnh vực y tế và tài chính — nơi bảo mật tuyệt đối là yêu cầu không thể nhượng bộ. Bên cạnh đó, dữ liệu tổng hợp (Synthetic Data) — các tập dữ liệu nhân tạo mang đặc tính thống kê của dữ liệu thực nhưng hoàn toàn không chứa thông tin cá nhân thật — đang được các công ty như Syntegra (y tế) và MOSTLY AI (tài chính) sử dụng rộng rãi để xây dựng và kiểm thử mô hình AI mà không vi phạm bất kỳ quy định bảo mật nào.

5. Con Người Giữ Quyền Kiểm Soát Cuối Cùng

Dù công nghệ có tiên tiến đến đâu, mọi khung quản trị AI đều phải tuân thủ một nguyên tắc bất di bất dịch: lấy con người làm trung tâm. Dự thảo Luật AI của Việt Nam quy định rõ ràng rằng trí tuệ nhân tạo không được thay thế hoàn toàn vai trò của con người trong các quyết định hành chính hoặc các quyết định trọng yếu ảnh hưởng đến quyền lợi công dân.

Nguyên tắc Human-in-the-loop (Con người trong vòng lặp) không chỉ là yêu cầu pháp lý — đây còn là thực hành quản trị khôn ngoan. Khi một hệ thống AI đề xuất từ chối hồ sơ vay vốn, từ chối bảo hiểm, hay đánh giá hiệu suất nhân viên, luôn cần có một con người có năng lực kiểm tra, phê duyệt và chịu trách nhiệm cuối cùng về quyết định đó. Amazon đã rút ra bài học đắt giá từ hệ thống AI tuyển dụng nội bộ: công cụ này vô tình học theo định kiến giới tính từ dữ liệu lịch sử, liên tục xếp hạng thấp hơn hồ sơ ứng viên nữ. Hệ thống chỉ được phát hiện và khai tử khi các nhà quản lý con người can thiệp vào quy trình xem xét.

Human-in-the-loop không có nghĩa là con người kiểm tra từng đầu ra của AI. Điều đó có nghĩa là con người thiết kế, giám sát hệ thống và chịu trách nhiệm pháp lý — AI là công cụ hỗ trợ, không phải người ra quyết định.

Lời Kết: Biến Tuân Thủ Thành Lợi Thế Cạnh Tranh

Quản trị AI có trách nhiệm không phải là rào cản cho đổi mới — đó chính là nền tảng để đổi mới bền vững. Các doanh nghiệp đi đầu trong quản trị AI sẽ không chỉ tránh được các khoản phạt khổng lồ mà còn xây dựng được niềm tin của khách hàng, đối tác và cơ quan quản lý — thứ tài sản vô hình nhưng vô giá trong nền kinh tế số.

Hành trình xây dựng một doanh nghiệp AI minh bạch đòi hỏi sự kết hợp giữa khung quản trị chuẩn quốc tế như NIST AI RMF hay ISO 42001 và các công cụ thực thi kỹ thuật hiện đại. Với nền tảng công nghệ toàn cầu của IBM (watsonx.governance, Guardium) và năng lực tư vấn, triển khai am hiểu bối cảnh pháp lý Việt Nam của FPT IS, doanh nghiệp có thể bắt đầu ngay từ hôm nay — không cần chờ đến khi bị thanh tra hoặc gặp sự cố.

Hành động đầu tiên: Kiểm tra xem hệ thống AI của bạn thuộc nhóm rủi ro nào theo Luật AI Việt Nam 2025. Đó là khởi điểm để xây dựng toàn bộ chiến lược quản trị AI cho tương lai.

Bài viết độc quyền bởi Ông Nguyễn Hữu Thịnh – Chuyên gia Tư vấn Giải pháp FPT IS, Tập đoàn FPT

Nguồn Tham Khảo

- IBM Security (2025). Cost of a Data Breach Report 2025.

- Luật Bảo vệ Dữ liệu Cá nhân (PDPD) Việt Nam – Nghị định 13/2023/NĐ-CP, hiệu lực 01/01/2026.

- Luật Trí tuệ Nhân tạo Việt Nam – Dự thảo thông qua 2025. Cổng thông tin Chính phủ Việt Nam.

- European Parliament (2024). EU Artificial Intelligence Act. Official Journal of the European Union.

- OWASP Foundation (2025). OWASP Top 10 for Large Language Model Applications.

- NIST (2023). AI Risk Management Framework (AI RMF 1.0).

- ISO/IEC 42001:2023. Artificial intelligence — Management system. International Organization for Standardization.

- IBM watsonx.governance.

- McMahan, B. et al. (2017). Communication-Efficient Learning of Deep Networks from Decentralized Data. AISTATS 2017. (Federated Learning)