Hybrid AI: Đa dạng mô hình, hạn chế rủi ro

Cuối năm 2022, khi ChatGPT xuất hiện, không ít lãnh đạo doanh nghiệp rơi vào trạng thái hưng phấn dễ hiểu. Đây rồi — một công nghệ có thể trả lời mọi câu hỏi, viết mọi thứ, xử lý mọi yêu cầu. Nhưng chưa đầy hai năm sau, bức tranh thực tế từ các đợt triển khai sản xuất bắt đầu rõ hơn: GenAI đơn lẻ xuất sắc trong vai trò thử nghiệm, nhưng lại lung lay khi phải đứng ở trung tâm của các quy trình kinh doanh cốt lõi — nơi một sai sót không chỉ là lỗi kỹ thuật mà có thể là rủi ro pháp lý, tài chính, hay thậm chí tính mạng bệnh nhân.

Đó là lý do vì sao Hybrid AI — kiến trúc kết hợp nhiều lớp mô hình và dữ liệu khác nhau trong một hệ thống thống nhất — đang trở thành lựa chọn chiến lược của những tổ chức muốn đi xa hơn giai đoạn proof-of-concept. Các vấn đề này đã được trình bày tại sự kiện Lenovo x FPT TechDay 2026. Tham khảo tại đây.

Vì sao một mô hình không đủ?

Để hiểu Hybrid AI, cần bắt đầu từ điểm yếu của GenAI khi vào môi trường doanh nghiệp thực sự. Các mô hình ngôn ngữ lớn được huấn luyện chủ yếu trên dữ liệu công khai — internet, sách, báo, mã nguồn mở. Điều này mang lại cho chúng khả năng ngôn ngữ ấn tượng, nhưng cũng tạo ra khoảng trống nguy hiểm: chúng không biết về quy trình phê duyệt tín dụng của ngân hàng bạn, không biết về phác đồ điều trị nội bộ của bệnh viện bạn, và không “nhớ” rằng sản phẩm X đã bị khai thác lỗ hổng bảo mật vào quý trước.

Hệ quả trực tiếp là hiện tượng “hallucination” — mô hình tự tin đưa ra thông tin sai hoặc bịa đặt, không có gì trong dữ liệu training tương ứng với thực tế nghiệp vụ. Trong môi trường doanh nghiệp “nhạy cảm” như tài chính hay y tế, đây là điểm chết. Một quyết định cho vay dựa trên đánh giá rủi ro sai lệch, hay một khuyến nghị điều trị không phù hợp guideline lâm sàng — đều không thể chấp nhận được dù lỗi xuất phát từ AI.

Bên cạnh đó, có vấn đề về khả năng giải thích (explainability). Các cơ quan quản lý tài chính (Basel, PCI-DSS) và y tế (HIPAA) không chỉ yêu cầu quyết định đúng, mà còn yêu cầu tổ chức chứng minh được tại sao quyết định đó được đưa ra, dựa trên dữ liệu nào, theo quy tắc nào. Một mô hình “hộp đen” — dù chính xác đến đâu — không đáp ứng được điều này.

Hybrid AI là gì — và tại sao không phải chỉ là RAG

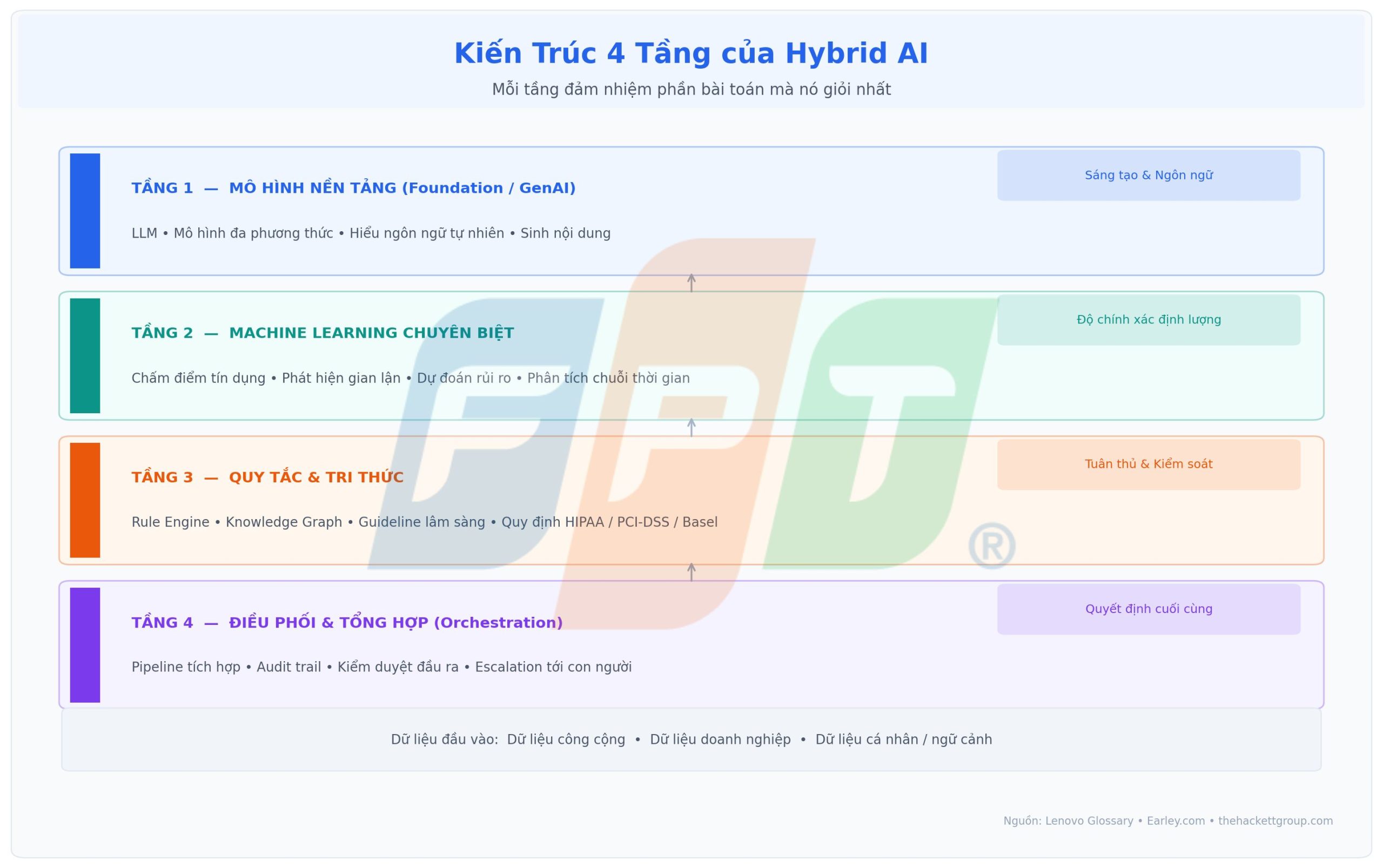

Hybrid AI, ở cốt lõi, là kiến trúc chủ đích kết hợp nhiều kỹ thuật AI: machine learning thống kê, deep learning, hệ luật (rule-based), AI biểu tượng (symbolic AI), knowledge graph — và GenAI — trong một pipeline có điều phối rõ ràng. Không có thành phần nào “làm tất cả”; mỗi lớp đảm nhận phần bài toán mà nó giỏi nhất.

Một cách hình dung đơn giản: nếu GenAI là một nhân viên mới thông minh, hiểu ngôn ngữ nhanh và sáng tạo trong diễn đạt, thì Hybrid AI là cả một hệ thống công ty — bao gồm người đó, cộng với các bộ phận kiểm soát rủi ro, phòng pháp lý, cơ sở dữ liệu nghiệp vụ, và cơ chế phê duyệt nội bộ. Nhân viên mới đề xuất; hệ thống kiểm duyệt, điều chỉnh, và quyết định cuối.

Cần phân biệt Hybrid AI với RAG (Retrieval-Augmented Generation) — một kỹ thuật đã phổ biến trong 2023-2024. RAG bổ sung ngữ cảnh cho GenAI bằng cách tìm kiếm tài liệu liên quan trước khi sinh text. Đây là bước tiến, nhưng vẫn còn giới hạn: nó chưa có tầng ML dự đoán định lượng, chưa có rule engine kiểm duyệt đầu ra, và chưa có knowledge graph để suy luận quan hệ phức tạp. Hybrid AI mở rộng từ nền tảng đó thành một kiến trúc đa tầng thực sự.

Cấu trúc điển hình của một hệ Hybrid AI doanh nghiệp thường gồm bốn tầng phối hợp nhau: tầng mô hình nền tảng (GenAI/LLM) đảm nhiệm hiểu ngôn ngữ và sinh nội dung; tầng machine learning chuyên biệt (mô hình dự đoán rủi ro, chấm điểm tín dụng, phát hiện bất thường) đảm nhiệm các phép đo định lượng cần độ chính xác cao; tầng quy tắc và tri thức (rule engine, knowledge graph, guideline lâm sàng, quy định pháp lý) kiểm duyệt và neo đầu ra vào thực tế nghiệp vụ; và cuối cùng là tầng điều phối (orchestration) tổng hợp và kiểm soát toàn bộ luồng quyết định.

Bài toán tài chính: Khi “hộp đen” không được phép tồn tại

Một trong những trường hợp triển khai Hybrid AI điển hình nhất đến từ ngành ngân hàng — nơi bài toán phát hiện gian lận vừa cần tốc độ mili-giây, vừa cần khả năng giải thích trước kiểm toán viên.

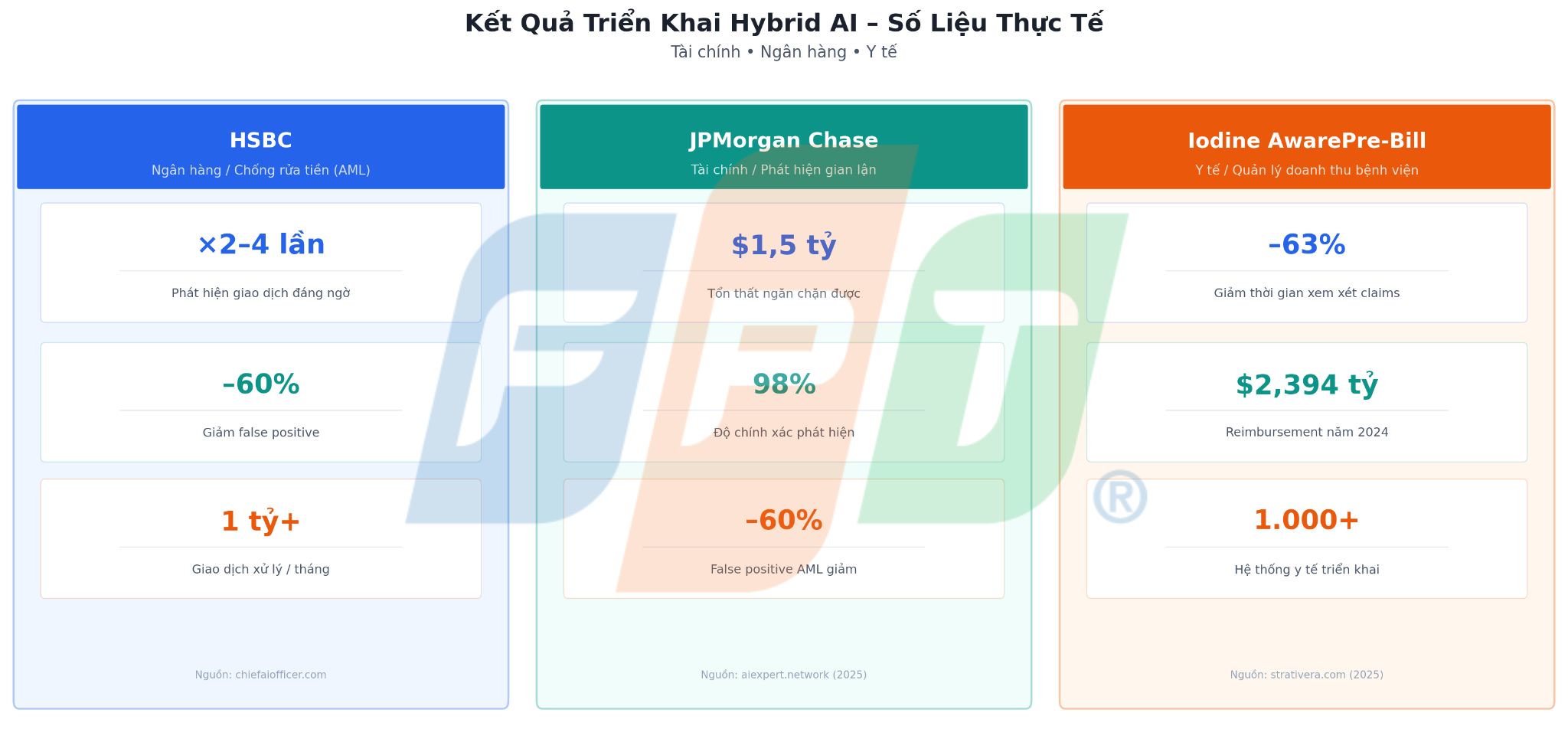

HSBC đã xây dựng hệ thống AI xử lý hơn 1 tỷ giao dịch mỗi tháng, phát hiện các hoạt động đáng ngờ nhiều gấp 2-4 lần so với phương pháp truyền thống, đồng thời giảm false positive xuống 60%. Điểm mấu chốt ở đây không chỉ là con số — mà là kiến trúc đằng sau. Hệ thống không chạy đơn thuần một mô hình deep learning; nó kết hợp machine learning phân tích hành vi giao dịch với các rule cứng tuân thủ quy định AML (chống rửa tiền), đặt trong một pipeline có thể tạo ra audit trail đầy đủ cho cơ quan quản lý.

JPMorgan Chase, với hơn 450 use case AI đang phát triển và ngân sách công nghệ 17 tỷ USD năm 2024, đã triển khai hệ thống phát hiện gian lận ngăn chặn 1,5 tỷ USD tổn thất với độ chính xác 98%. Trong giám sát AML, AI giảm false positive 60% qua việc đánh dấu các mẫu đáng ngờ trong hàng triệu giao dịch mỗi ngày.

Những con số này ấn tượng, nhưng điều đáng chú ý hơn là cách kiến trúc lai cho phép ngân hàng vừa tận dụng sức mạnh của ML trong nhận diện mẫu, vừa giữ được tính minh bạch qua các lớp luật nghiệp vụ có thể kiểm tra — thứ mà một mô hình đơn lẻ không thể cung cấp.

Bài toán y tế: Khi GenAI cần “bác sĩ giám sát”

Trong y tế, thách thức còn phức tạp hơn, vì lỗi AI có thể ảnh hưởng trực tiếp đến sức khỏe và tính mạng. Đây cũng là ngành mà Hybrid AI đang thu hút đầu tư nhanh nhất.

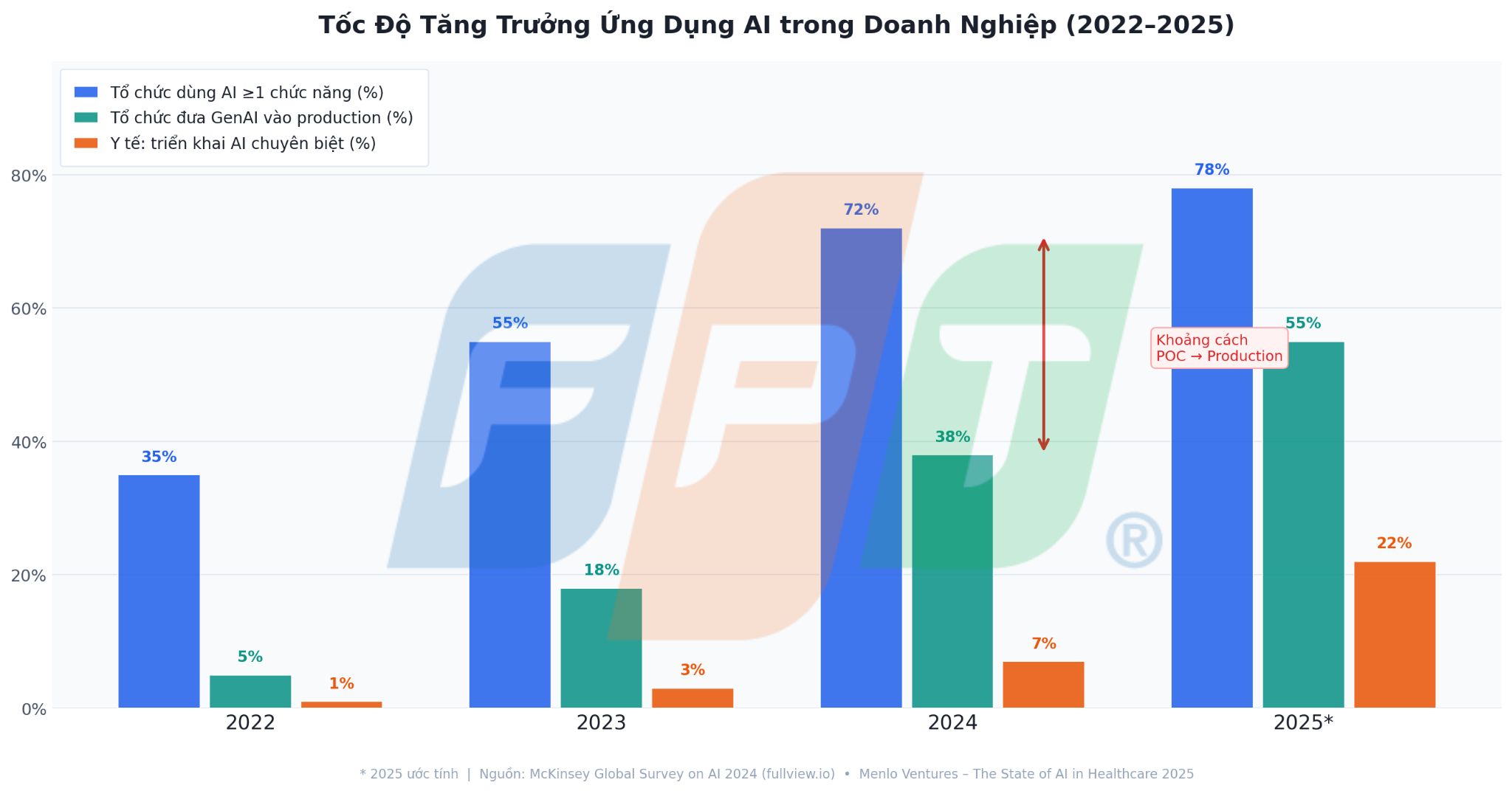

Theo nghiên cứu của Menlo Ventures, 22% tổ chức y tế đã triển khai các công cụ AI chuyên biệt, tăng 7 lần so với 2024 và 10 lần so với 2023. Đà tăng tốc này không phải ngẫu nhiên — nó phản ánh sự chín muồi của kiến trúc Hybrid AI cho phép ứng dụng AI an toàn trong môi trường lâm sàng nghiêm ngặt.

Hãy xem xét trường hợp hệ thống hỗ trợ quản lý doanh thu bệnh viện (Revenue Cycle Management). Nền tảng Iodine AwarePre-Bill đã đạt mức giảm 63% thời gian xem xét claims, với tổng reimbursement hơn 2,394 tỷ USD trên hơn 1.000 hệ thống y tế trong năm 2024. Hệ thống này không đơn giản là một chatbot GenAI đọc hồ sơ bệnh nhân — nó kết hợp NLP để trích xuất thông tin lâm sàng, mô hình ML dự đoán mã ICD phù hợp, và rule engine kiểm tra sự tương thích với quy định bảo hiểm — toàn bộ trong một pipeline tuân thủ HIPAA.

Điều quan trọng cần nhấn mạnh: trong y tế, vai trò của lớp quy tắc và tri thức trong kiến trúc Hybrid AI không chỉ là “kiểm soát chất lượng” — nó là yêu cầu pháp lý. Một hệ thống hỗ trợ chẩn đoán phải có thể chứng minh rằng khuyến nghị của nó tuân theo clinical guideline hiện hành, không phải chỉ dựa trên pattern GenAI học được từ internet.

Cách triển khai thực tế — ba pattern phổ biến

Sau nhiều năm làm việc với các tổ chức trong giai đoạn chuyển đổi từ POC sang production, có thể nhận diện ba pattern triển khai Hybrid AI phổ biến nhất, mỗi cái phù hợp với ngữ cảnh nghiệp vụ khác nhau.

Pattern đầu tiên là “GenAI làm front-end, ML làm core decision”. GenAI đảm nhiệm phần hội thoại, giải thích, và trích xuất thông tin từ ngôn ngữ tự nhiên của người dùng — rồi chuyển đầu ra này thành input có cấu trúc cho mô hình ML chuyên biệt thực sự ra quyết định. Đây là pattern phù hợp nhất với bài toán chấm điểm tín dụng, đánh giá rủi ro vận hành, hay phân loại mức độ ưu tiên trong chuỗi cung ứng.

Pattern thứ hai là “RAG nâng cấp với tầng tri thức”. Thay vì chỉ retrieval đơn giản, hệ thống sử dụng ML để xếp hạng và lọc tài liệu, sau đó đưa qua knowledge graph để làm giàu thêm mối quan hệ ngữ nghĩa trước khi GenAI tổng hợp câu trả lời. Pattern này hiệu quả trong các use case hỗ trợ quyết định lâm sàng, tra cứu chính sách pháp lý, hoặc hỗ trợ kỹ thuật nội bộ.

Pattern thứ ba là “hậu kiểm bằng rule engine”. GenAI đề xuất đầu ra, nhưng trước khi đến tay người dùng, đầu ra này phải đi qua một lớp kiểm duyệt cứng: rule engine kiểm tra vi phạm quy định, knowledge graph xác minh tính nhất quán, và ngưỡng tin cậy quyết định khi nào cần escalate lên con người. Đây là kiến trúc quan trọng nhất với các ngành “zero-tolerance” như y tế phẫu thuật, phê duyệt giao dịch lớn, hay quy trình tuân thủ.

Bảo mật không phải “add-on” — phải là kiến trúc

Một điểm thường bị bỏ qua trong các cuộc thảo luận về Hybrid AI là vấn đề bảo mật dữ liệu. Trong khi GenAI thuần túy thường đòi hỏi đưa dữ liệu ra ngoài (vào API của nhà cung cấp mô hình), Hybrid AI cho phép triển khai theo nguyên tắc “model đến gần data, không phải data đi đến model”. Mô hình ML và rule engine chạy on-premise hoặc trong VPC riêng; chỉ những thông tin phi nhạy cảm, đã được ẩn danh hóa mới tiếp xúc với foundation model bên ngoài nếu cần.

Đây không chỉ là vấn đề kỹ thuật — đây là điều kiện tiên quyết để một tổ chức tài chính hay y tế có thể thực sự triển khai AI vào core process mà không vi phạm quy định bảo vệ dữ liệu. Không có kiến trúc này, hầu hết các use case “hấp dẫn” với dữ liệu nhạy cảm về cơ bản là bất khả thi trong môi trường regulated.

Từ chiến thuật đến chiến lược

Hybrid AI không phải là hướng đi của riêng ngành nào. Nhìn vào bức tranh lớn hơn: 78% tổ chức hiện đã sử dụng AI trong ít nhất một chức năng kinh doanh, tăng từ 55% năm 2023 — nhưng con số thực sự đáng chú ý là tỷ lệ đang scaling lên production vẫn còn thấp hơn nhiều so với tỷ lệ đang pilot. Khoảng cách đó chính là nơi Hybrid AI đang lấp đầy.

Sự thay đổi thực sự không phải là về công nghệ — mà là về tư duy. Doanh nghiệp đang chuyển từ câu hỏi “AI nào tốt nhất?” sang câu hỏi “Kiến trúc nào cho phép AI ra quyết định đáng tin cậy trong ngữ cảnh của chúng ta?” Đó là câu hỏi của người xây dựng hệ thống, không phải của người dùng thử công cụ.

Trong 3-5 năm tới, phần lớn ứng dụng AI cấp doanh nghiệp sẽ mang tính lai theo mặc định — không phải vì đây là xu hướng công nghệ, mà vì đây là cách duy nhất để AI tạo ra giá trị thực trong môi trường nơi sai sót có giá.

Bài viết độc quyền bởi Ông. Lê Văn Hoàng Trung Phó Giám đốc Trung tâm Dịch vụ Hạ tầng FPT IS, Tập đoàn FPT

Ông Lê Văn Hoàng Trung là chuyên gia với hơn 17 năm kinh nghiệm trong lĩnh vực tư vấn giải pháp CNTT cho khối doanh nghiệp, từng được vinh danh Top 100 FPT năm 2016 và đạt Top 6 cuộc thi tìm kiếm tài năng “Trạng FPT” năm 2013, ghi nhận những đóng góp nổi bật về chuyên môn và năng lực tư vấn công nghệ. Ông đảm nhiệm vai trò Tư vấn trưởng (Lead Solution Consultant) cho nhiều dự án hạ tầng công nghệ quy mô lớn với giá trị 50–200 tỷ đồng, đồng thời có kinh nghiệm chuyên sâu tư vấn và triển khai giải pháp cho các lĩnh vực trọng điểm như sản xuất công nghiệp, bán lẻ, dầu khí và giao thông, hỗ trợ doanh nghiệp xây dựng và tối ưu hạ tầng CNTT, trung tâm dữ liệu, hệ thống mạng và các nền tảng số phục vụ vận hành và chuyển đổi số.

Tài liệu tham khảo

- Information Age – What is Hybrid AI?

- Earley – What is Hybrid AI Approach to Data Discovery

- The Hackett Group – Glossary: Hybrid AI

- Lenovo – Hybrid AI Glossary

- NTT Data – Not All Hallucinations Are Bad: Constraints and Benefits of Generative AI

- Zenodo – Hybrid AI in Healthcare Financial Security (2024)

- IJCAT – Hybrid AI for Cybersecurity and Fraud Detection

- DFKI – On Explanations for Hybrid Artificial Intelligence

- Tucuvi – Hybrid AI in Healthcare

- Ramp – What is Hybrid AI

- ICT Vietnam – Tại sao AI lai là xu hướng tiếp theo

- Aptech FPT – Hybrid AI: Cầu nối giữa lý thuyết và thực tiễn

- HSBC AI Case Study – Chief AI Officer Blog, 2025: HSBC phát hiện 2-4 lần nhiều giao dịch đáng ngờ hơn, giảm false positive 60% — https://chiefaiofficer.com/blog/how-hsbcs-ai-catches-4x-more-financial-criminals-while-cutting-false-alarms-by-60/

- JPMorgan Chase AI Case Study – AI Expert Network, 2025: Hệ thống fraud detection ngăn 1,5 tỷ USD tổn thất, độ chính xác 98%, AML false positive giảm 60% — https://aiexpert.network/ai-at-jpmorgan/

- Iodine AwarePre-Bill – Strativera, 2025: Giảm 63% thời gian xem xét claims, 2,394 tỷ USD reimbursement trên 1.000+ hệ thống y tế năm 2024 — https://strativera.com/ai-healthcare-business-transformation-frameworks-2025/

- Menlo Ventures – 2025: The State of AI in Healthcare: 22% tổ chức y tế đã triển khai AI chuyên biệt, tăng 7 lần so với 2024 — https://menlovc.com/perspective/2025-the-state-of-ai-in-healthcare/

- Fullview.io / AI Statistics 2025 – 78% tổ chức đã dùng AI trong ít nhất một chức năng kinh doanh năm 2024-2025 — https://www.fullview.io/blog/ai-statistics