Kỷ nguyên hạ tầng AI: Từ Hệ Thống Làm Mát Bằng Chất Lỏng Đến “Nhà Máy AI Gigawatt”

Trí tuệ nhân tạo đang định hình lại toàn bộ ngành công nghiệp — nhưng phía sau mỗi mô hình AI tiên tiến là một câu hỏi vật lý rất thực tế: làm thế nào để nuôi dưỡng “cơn khát” tính toán khổng lồ này mà không làm sụp đổ ngân sách điện năng và không gian vật lý của doanh nghiệp? Bài viết này đi sâu vào nền tảng phần cứng và trung tâm dữ liệu thế hệ mới, với những điểm nhấn là bộ vi xử lý Intel Xeon 6, hợp tác chiến lược Lenovo × NVIDIA và công nghệ làm mát Neptune thế hệ thứ 6 — những nền tảng đang tái định nghĩa khái niệm “nhà máy AI” ở quy mô gigawatt.

Tham khảo bài viết về Hybrid AI tại đây

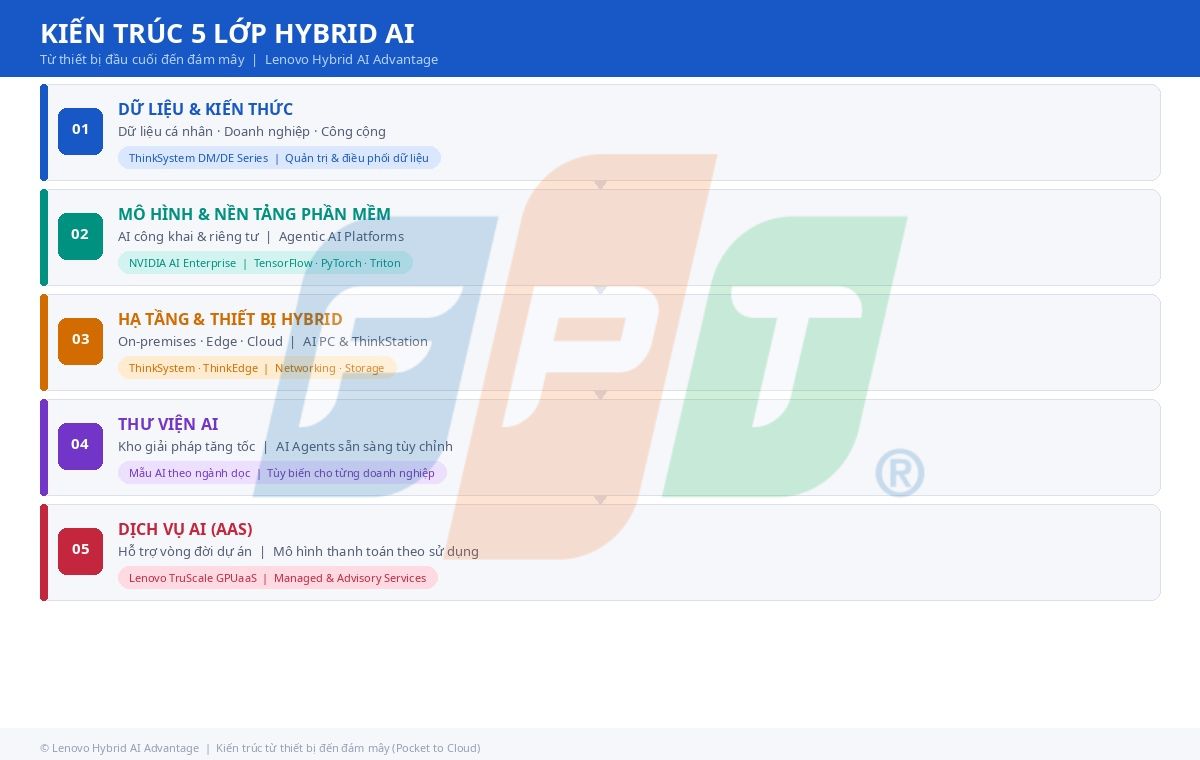

Kiến Trúc Hybrid AI: Năm Lớp Nền Tảng Từ Thiết Bị Đến Đám Mây

Trước khi bàn đến từng thành phần phần cứng cụ thể, cần hiểu rằng hạ tầng AI hiện đại không phải là một sản phẩm đơn lẻ mà là một hệ sinh thái toàn diện. Lenovo Hybrid AI Advantage xây dựng kiến trúc xoay quanh năm lớp chức năng, mỗi lớp giải quyết một nhóm thách thức riêng biệt:

Hình 1: Kiến trúc 5 lớp Hybrid AI — từ dữ liệu đến dịch vụ

Lớp Dữ Liệu & Kiến Thức — Nền Tảng Của Mọi Quyết Định AI

Không có dữ liệu chất lượng cao, mô hình AI dù tiên tiến đến đâu cũng không thể tạo ra giá trị thực sự. Lớp này kết hợp dữ liệu cá nhân, dữ liệu doanh nghiệp và dữ liệu công cộng, được quản lý bởi các hệ thống lưu trữ hiệu suất cao như Lenovo ThinkSystem DM/DE Series. Điều quan trọng là dữ liệu phải luôn sẵn sàng, an toàn và có thể truy cập xuyên suốt từ vùng biên (edge) đến đám mây — một yêu cầu nghe có vẻ đơn giản nhưng đòi hỏi kiến trúc điều phối và quản trị dữ liệu cực kỳ tinh vi.

Lớp Mô Hình & Phần Mềm — Bộ Não Của Hệ Thống

Đây là nơi các mô hình AI — cả công khai lẫn riêng tư — được triển khai và vận hành. Nền tảng Agentic AI cho phép các tác nhân AI tự động hóa quy trình phức tạp, trong khi NVIDIA AI Enterprise cung cấp phần mềm cấp doanh nghiệp tối ưu hóa hiệu suất. Các framework quen thuộc như TensorFlow, PyTorch và Triton inference server đều được hỗ trợ đầy đủ, giúp đội ngũ kỹ thuật không cần thay đổi quy trình phát triển hiện có.

Lớp Hạ Tầng Hybrid — Linh Hoạt Ở Mọi Vị Trí

Từ máy tính xách tay AI PC đến máy trạm ThinkStation cho nhà khoa học dữ liệu, từ máy chủ ThinkSystem tại trung tâm dữ liệu đến ThinkEdge tại hiện trường — lớp này đảm bảo năng lực tính toán AI có thể triển khai ở bất kỳ đâu mà dữ liệu cần được xử lý. Mô hình hybrid cho phép doanh nghiệp chọn lựa vị trí xử lý tối ưu: tại chỗ để bảo mật, ở biên để độ trễ thấp, trên đám mây để mở rộng quy mô.

Lớp Thư Viện AI & Dịch Vụ — Tăng Tốc Độ Triển Khai

Thay vì xây dựng từ đầu, doanh nghiệp có thể tận dụng kho mẫu AI và tác nhân AI đã được kiểm nghiệm thực tế, tùy chỉnh cho từng ngành dọc. Cùng với đó, mô hình dịch vụ linh hoạt TruScale (Everything-as-a-Service) cho phép trả tiền theo mức sử dụng thực tế, giảm thiểu rủi ro tài chính khi đầu tư vào hạ tầng AI — đặc biệt quan trọng với các doanh nghiệp đang ở giai đoạn khám phá.

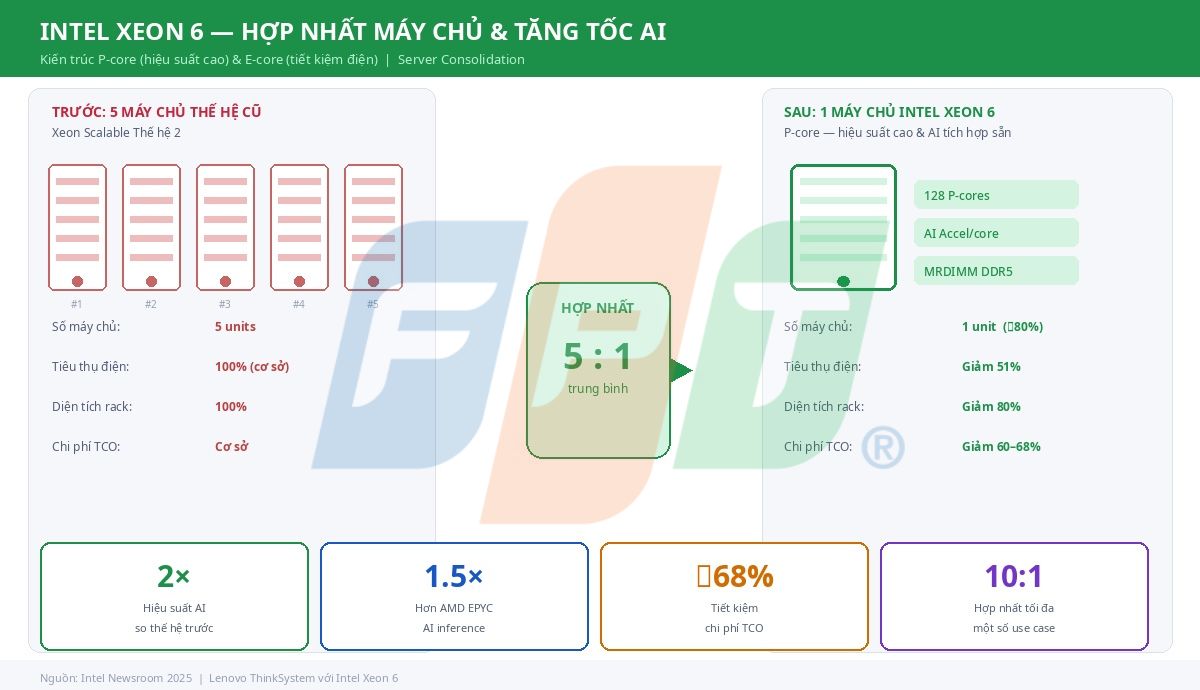

Intel Xeon 6: Cuộc Cách Mạng Hợp Nhất Máy Chủ Cho Kỷ Nguyên Hạ tầng AI

Một trong những rào cản lớn nhất khi triển khai AI trong doanh nghiệp không phải là thiếu ý tưởng — mà là cơ sở hạ tầng CPU quá cũ, kém hiệu quả và ngốn quá nhiều điện. Intel Xeon 6 ra đời như một câu trả lời toàn diện cho bài toán này, với chiến lược kiến trúc kép độc đáo.

Hình 2: Intel Xeon 6 — Hợp nhất 5 máy chủ cũ thành 1, tiết kiệm đến 68% TCO

Kiến Trúc Kép P-core & E-core: Mỗi Nhiệm Vụ Có Bộ Xử Lý Riêng

Intel Xeon 6 áp dụng triết lý thiết kế rõ ràng: P-core (Performance-core) được tối ưu hóa cho các tác vụ tính toán nặng như huấn luyện AI, suy luận mô hình ngôn ngữ lớn và HPC; trong khi E-core (Efficient-core) phục vụ khối lượng công việc cần mật độ cao và hiệu năng/watt tốt nhất, điển hình là ứng dụng cloud-native và microservices. Chiến lược này không chỉ tối ưu hóa hiệu suất mà còn đảm bảo doanh nghiệp không phải “trả tiền cho năng lực mình không dùng”.

Con Số Biết Nói: 5:1 Hợp Nhất, -68% Chi Phí TCO

Các số liệu từ Intel và Lenovo cho thấy tiềm năng biến đổi hạ tầng đáng kinh ngạc:

- Hợp nhất 5:1 trung bình: Một máy chủ Xeon 6 thay thế 5 máy chủ thế hệ Xeon cũ (2nd Gen), giảm 80% số lượng máy chủ cần quản lý.

- Tiết kiệm điện lên đến 51%: Ít máy chủ hơn đồng nghĩa với ít điện tiêu thụ hơn, giảm lượng phát thải carbon tương ứng.

- Tiết kiệm TCO lên đến 68%: Kết hợp giữa chi phí phần cứng, vận hành và điện năng, doanh nghiệp có thể tái đầu tư ngân sách tiết kiệm được vào các dự án AI mới.

- Hiệu suất AI inference gấp 1.5x so với AMD EPYC thế hệ 5 — với số lõi ít hơn 1/3.

- Tích hợp AI acceleration trong từng nhân xử lý: Cả P-core và E-core đều có tăng tốc AI tích hợp (Intel AMX), cho phép chạy inference và các mô hình GenAI nhỏ ngay trên CPU mà không cần GPU.

Trong bối cảnh chi phí điện năng trung tâm dữ liệu ngày càng tăng, đặc biệt tại khu vực châu Á — Thái Bình Dương nơi Lenovo dự báo tiêu thụ điện năng trung tâm dữ liệu sẽ tăng từ 320TWh (2024) lên 780TWh vào năm 2030 — khả năng hợp nhất và tiết kiệm điện của Xeon 6 mang ý nghĩa chiến lược vượt ra ngoài bài toán chi phí đơn thuần.

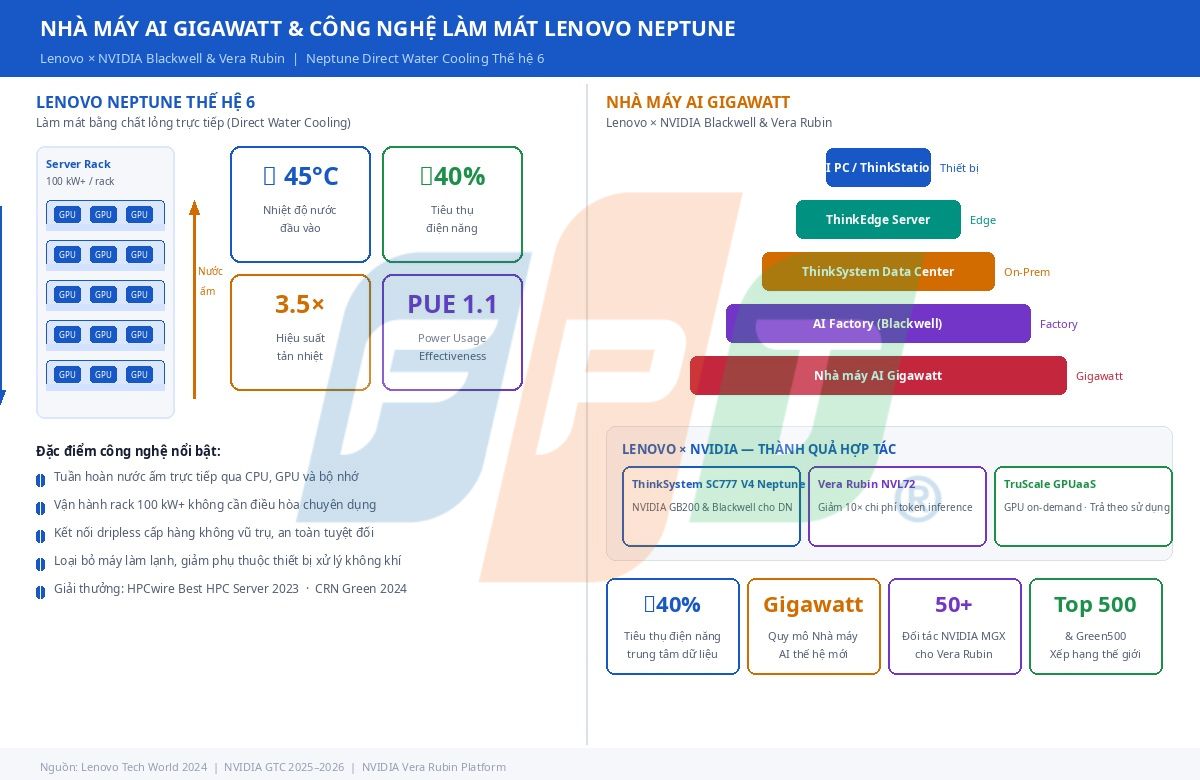

Nhà Máy AI Gigawatt: Khi Lenovo Neptune Gặp NVIDIA Blackwell & Vera Rubin

Nếu Intel Xeon 6 giải quyết bài toán hiệu quả ở cấp máy chủ, thì câu chuyện ở cấp trung tâm dữ liệu còn kịch tính hơn nhiều. Khi mật độ công suất trên mỗi rack tăng vọt lên 100kW — thậm chí 130–150kW với các hệ thống GB300 NVL72 thế hệ mới nhất — hệ thống làm mát truyền thống bằng không khí đơn giản là không còn đủ khả năng đáp ứng.

Hình 3: Nhà máy AI Gigawatt và công nghệ làm mát Lenovo Neptune thế hệ 6

Lenovo Neptune Thế Hệ 6: Nước Ấm Là Vũ Khí Bí Mật

Ra mắt tại Tech World 2024 dưới dạng ThinkSystem N1380 Neptune, công nghệ làm mát chất lỏng thế hệ thứ 6 của Lenovo hoạt động theo nguyên lý tưởng chừng đơn giản: tuần hoàn nước ấm trực tiếp qua CPU, GPU và bộ nhớ để loại bỏ nhiệt ngay tại nguồn. Điểm khác biệt cốt lõi so với hệ thống nước lạnh thông thường là Neptune vận hành ở nhiệt độ nước đầu vào lên đến 45°C (thay vì ~18°C của hệ thống chilling truyền thống), loại bỏ hoàn toàn nhu cầu máy làm lạnh và giảm đáng kể sự phụ thuộc vào thiết bị xử lý không khí.

Kết quả đo lường thực tế từ các triển khai hiện tại:

- Giảm 40% tiêu thụ điện năng so với hệ thống làm mát bằng không khí tương đương.

- Cải thiện hiệu suất tản nhiệt 3.5 lần so với air-cooling truyền thống.

- PUE (Power Usage Effectiveness) đạt 1.1 — gần với ngưỡng lý tưởng, có nghĩa là chỉ 0.1W điện dùng cho làm mát trên mỗi 1W điện tính toán.

- Vận hành rack 100kW+ mà không cần điều hòa không khí chuyên dụng — thay đổi hoàn toàn cách thiết kế trung tâm dữ liệu AI.

- DreamWorks Animation ghi nhận cải thiện hiệu suất 20% với nhu cầu làm mát thấp hơn sau khi áp dụng Neptune.

ThinkSystem SC777 V4 Neptune: Cầu Nối Giữa Doanh Nghiệp Và NVIDIA Blackwell

Đây là sản phẩm cụ thể hóa mối quan hệ đối tác chiến lược Lenovo × NVIDIA. ThinkSystem SC777 V4 Neptune sử dụng chassis N1380 để đưa NVIDIA GB200 và nền tảng Blackwell vào tầm tay doanh nghiệp, cho phép chạy các mô hình AI hàng nghìn tỷ tham số trong một thiết kế nhỏ gọn. Điều này có nghĩa là ngay cả những doanh nghiệp không có trung tâm dữ liệu quy mô lớn cũng có thể vận hành mô hình AI frontier-class tại chỗ với chi phí năng lượng được kiểm soát.

Tầm Nhìn Gigawatt: NVIDIA Vera Rubin Và Nhà Máy AI Thế Hệ Tiếp Theo

Nhìn xa hơn, kiến trúc NVIDIA Vera Rubin NVL72 (dự kiến đưa vào sản xuất đầy đủ năm 2026) đang định hình khái niệm “nhà máy AI gigawatt” — các cơ sở tính toán AI ở quy mô 100MW đến hàng gigawatt, được thiết kế 100% làm mát chất lỏng. Hơn 50 đối tác MGX của NVIDIA, trong đó có Lenovo, đang chuẩn bị sẵn sàng cho thế hệ kiến trúc này. NVIDIA Vera Rubin hứa hẹn cắt giảm chi phí token inference 10 lần so với Blackwell, trong khi yêu cầu ít GPU hơn 4 lần để huấn luyện mô hình MoE — những cải tiến mang tính bước ngoặt không chỉ về kỹ thuật mà còn về kinh tế.

Từ Máy Trạm Đến Nhà Máy: Lộ Trình Mở Rộng Liền Mạch

Một trong những điểm độc đáo của khung giải pháp Lenovo Hybrid AI Advantage là thiết kế theo kiểu đồng nhất kiến trúc từ nhỏ đến lớn. Doanh nghiệp có thể bắt đầu phát triển và kiểm thử trên máy trạm ThinkStation PGX, rồi mở rộng lên ThinkSystem data center và cuối cùng là AI Factory quy mô lớn — toàn bộ hành trình này diễn ra trên cùng một nền tảng phần mềm, công cụ và quy trình phát triển, loại bỏ gần như hoàn toàn chi phí chuyển đổi kỹ thuật.

Hạ Tầng AI Không Phải Chi Phí — Đây Là Lợi Thế Cạnh Tranh

Nhìn lại toàn bức tranh, ba xu hướng hội tụ đang tái định nghĩa hạ tầng AI doanh nghiệp trong năm 2025 và những năm tiếp theo:

- CPU thế hệ mới (Intel Xeon 6) giải phóng ngân sách và không gian: Hợp nhất máy chủ theo tỷ lệ 5:1, tiết kiệm đến 68% TCO đồng thời tích hợp AI acceleration trong từng nhân xử lý — CPU không còn là điểm nghẽn của hệ thống AI.

- Làm mát chất lỏng không còn là đặc quyền của siêu máy tính: Neptune thế hệ 6 đưa công nghệ làm mát tiên tiến vào hạ tầng doanh nghiệp thông thường, mở ra khả năng chạy GPU AI mật độ cao mà không cần đại tu cơ sở vật chất.

- Nhà máy AI theo nghĩa đen: Hợp tác Lenovo × NVIDIA đang xây dựng hệ sinh thái nhà máy AI từ quy mô 10kW đến gigawatt, với kiến trúc tham chiếu chuẩn hóa giúp doanh nghiệp triển khai nhanh và an toàn.

Khi trí tuệ nhân tạo chuyển từ “thí nghiệm thú vị” sang “hạ tầng chiến lược” của mọi tổ chức, những quyết định về phần cứng và kiến trúc dữ liệu hôm nay sẽ quyết định ai có thể vận hành mô hình AI tiên tiến nhất, nhanh nhất và hiệu quả nhất trong 3–5 năm tới. Đầu tư vào hạ tầng AI đúng đắn không phải là chi phí — đây là nền tảng của lợi thế cạnh tranh trong kỷ nguyên AI.

Bài viết độc quyền bởi Ông. Lê Văn Hoàng Trung Phó Giám đốc Trung tâm Dịch vụ Hạ tầng FPT IS, Tập đoàn FPT

Ông Lê Văn Hoàng Trung là chuyên gia với hơn 17 năm kinh nghiệm trong lĩnh vực tư vấn giải pháp CNTT cho khối doanh nghiệp, từng được vinh danh Top 100 FPT năm 2016 và đạt Top 6 cuộc thi tìm kiếm tài năng “Trạng FPT” năm 2013, ghi nhận những đóng góp nổi bật về chuyên môn và năng lực tư vấn công nghệ. Ông đảm nhiệm vai trò Tư vấn trưởng (Lead Solution Consultant) cho nhiều dự án hạ tầng công nghệ quy mô lớn với giá trị 50–200 tỷ đồng, đồng thời có kinh nghiệm chuyên sâu tư vấn và triển khai giải pháp cho các lĩnh vực trọng điểm như sản xuất công nghiệp, bán lẻ, dầu khí và giao thông, hỗ trợ doanh nghiệp xây dựng và tối ưu hạ tầng CNTT, trung tâm dữ liệu, hệ thống mạng và các nền tảng số phục vụ vận hành và chuyển đổi số.

Nguồn tham khảo:

Lenovo Tech World 2024

Intel Newsroom 2025

NVIDIA GTC 2025–2026

HPCwire

Data Centre Magazine

Lenovo Hybrid AI Advantage Documentation